SỐC: Hàng chục nghìn bài báo khoa học năm 2025 trích dẫn tài liệu tham khảo “ma” được tạo ra bởi trí tuệ nhân tạo (AI)

1. Thực trạng báo động: Con số khổng lồ

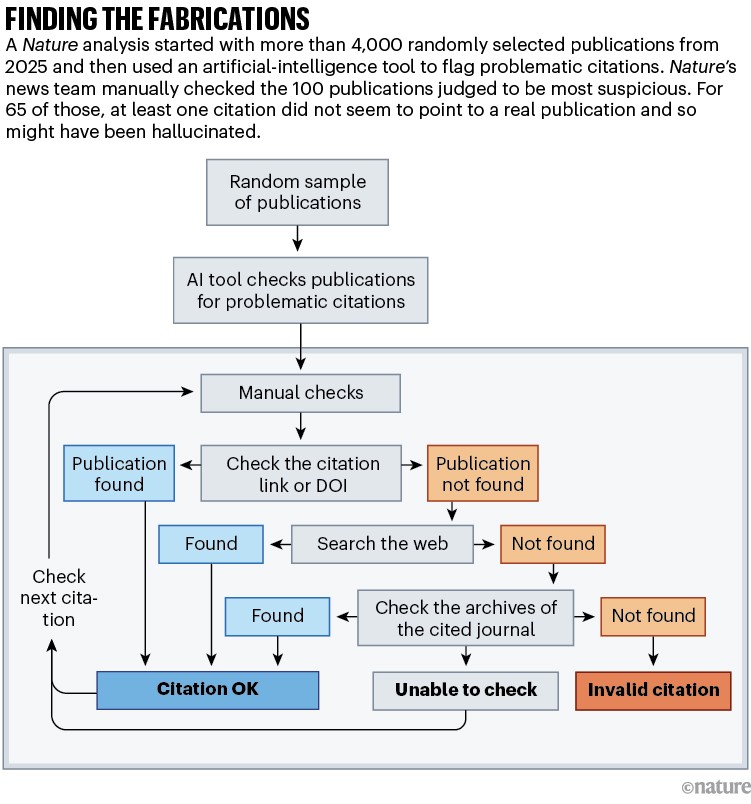

Mở đầu bài viết, Nature đưa ra một con số gây sốc: Theo một phân tích dữ liệu quy mô lớn, có hơn 110.000 bài báo khoa học xuất bản chỉ riêng trong năm 2025 chứa các trích dẫn "ma" (hallucinated citations). Đây là những tài liệu tham khảo không hề tồn tại trong thực tế, nhưng được trình bày một cách cực kỳ thuyết phục về tên tác giả, tên tạp chí và năm xuất bản.

Sự gia tăng đột biến này trùng khớp với việc các mô hình ngôn ngữ lớn (large language model – LLM) như ChatGPT trở nên phổ biến trong giới nghiên cứu. Thay vì sử dụng AI để hỗ trợ tóm tắt, nhiều tác giả đã để AI tự tạo ra danh mục tham khảo, dẫn đến việc "rác" dữ liệu xâm nhập vào các hệ thống lưu trữ học thuật lớn.

2. Cơ chế của sự "ảo giác"

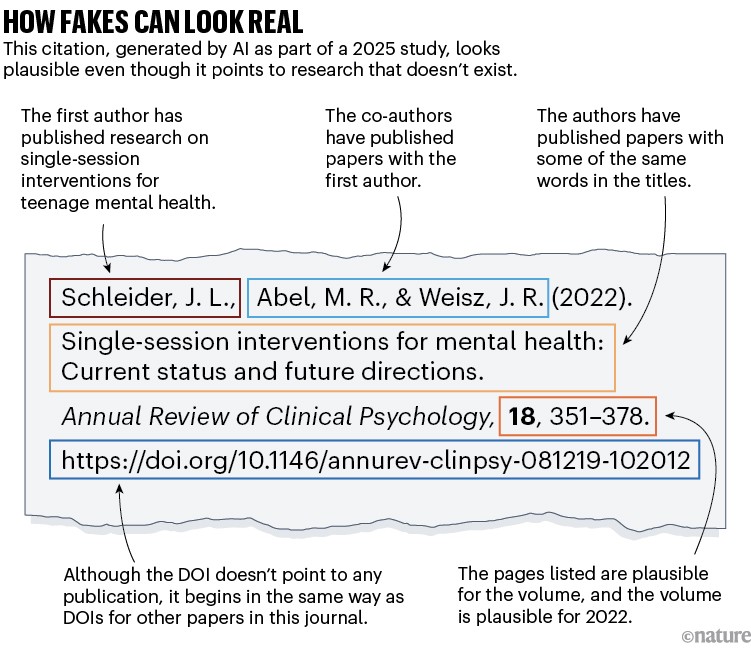

Bài viết giải thích tại sao AI lại tạo ra các trích dẫn sai. Các mô hình LLM được thiết kế để dự đoán từ tiếp theo dựa trên xác suất chứ không phải để truy xuất dữ liệu thực tế từ các cơ sở dữ liệu như PubMed hay Scopus (trừ khi được tích hợp các công cụ tìm kiếm đặc biệt).

Khi một nhà khoa học yêu cầu AI tìm nguồn cho một khẳng định cụ thể, AI có xu hướng "ghép nối" tên của các giáo sư đầu ngành với những tiêu đề bài báo nghe có vẻ hợp lý và các tạp chí uy tín. Kết quả là một trích dẫn trông hoàn toàn "thật" nhưng thực chất là hư cấu. Điều nguy hiểm là các trích dẫn này thường hỗ trợ rất tốt cho các lập luận của tác giả, khiến người phản biện (reviewer) nếu không kiểm tra kỹ sẽ dễ dàng bỏ qua.

3. Hệ lụy đối với liêm chính khoa học

Tác động của hiện tượng này không chỉ dừng lại ở một vài bài báo sai sót. Nature chỉ ra ba hệ lụy nghiêm trọng:

- Làm xói mòn lòng tin: Khi độc giả và các nhà khoa học khác cố gắng tìm đọc nguồn gốc của một khám phá nhưng không thấy, niềm tin vào toàn bộ công trình đó và cả tạp chí xuất bản nó sẽ bị sụp đổ.

- Làm nhiễu các chỉ số đánh giá: Các thuật toán tính chỉ số ảnh hưởng (Impact Factor) hay chỉ số H-index có thể bị đánh lừa bởi những trích dẫn này, tạo ra những "ngôi sao học thuật ảo" hoặc thổi phồng giá trị của một lĩnh vực nghiên cứu không có thật.

- Ô nhiễm AI: Đây là vòng lặp nguy hiểm nhất. Khi các mô hình AI thế hệ tiếp theo được huấn luyện trên những bài báo chứa trích dẫn ảo này, chúng sẽ coi đó là sự thật, từ đó tiếp tục nhân bản sai lầm với quy mô lớn hơn, tạo ra một "bãi rác thông tin" không thể cứu vãn.

4. Trách nhiệm của các bên liên quan

Bài viết dành một phần lớn để thảo luận về việc ai phải chịu trách nhiệm.

- Các nhà xuất bản: Người phát ngôn từ các "ông lớn" như Elsevier, Springer Nature và Wiley cho biết họ đang triển khai các công cụ quét tự động để đối chiếu trích dẫn với cơ sở dữ liệu thực tế. Tuy nhiên, họ cũng thừa nhận rằng đây là một cuộc chạy đua vũ trang đầy thách thức khi AI ngày càng tinh vi hơn trong việc bắt chước định dạng chuẩn.

- Người phản biện (Peer Reviewers): Bài viết nhấn mạnh rằng lỗi không chỉ ở tác giả mà còn ở quy trình phản biện. Nhiều người phản biện quá tải đã không kiểm tra tính xác thực của từng nguồn tham khảo. Một khảo sát cho thấy một lượng lớn bài báo có trích dẫn ảo đã vượt qua vòng kiểm duyệt ở cả các tạp chí có chỉ số ảnh hưởng cao.

5. Giải pháp và hướng đi tương lai

Để giải quyết tình trạng này, cộng đồng khoa học đang đề xuất một số biện pháp cứng rắn:

1. Gắn nhãn AI: Yêu cầu các tác giả phải khai báo cụ thể phần nào trong bài viết có sự hỗ trợ của AI và các công cụ nào đã được dùng để kiểm chứng trích dẫn.

2. Hệ thống xác thực tự động: Phát triển các plugin bắt buộc cho phần mềm quản lý trích dẫn (như Zotero, Mendeley) để tự động báo đỏ nếu một nguồn tham khảo không tồn tại trong hệ thống đăng ký DOI toàn cầu.

3. Hình phạt nghiêm khắc: Một số chuyên gia đề xuất rằng việc sử dụng trích dẫn bịa tạc nên được coi là hành vi gian lận khoa học (misconduct) tương đương với ngụy tạo dữ liệu, có thể dẫn đến việc bị cấm xuất bản vĩnh viễn.

Kết luận

Bài viết trên Nature khép lại với một lời cảnh báo: Khoa học vận hành dựa trên vai của những người khổng lồ, và những "người khổng lồ" đó chính là các công trình nghiên cứu đi trước. Nếu nền móng này bị thay thế bằng những trích dẫn ảo giác, toàn bộ tòa tháp tri thức nhân loại sẽ đứng trước nguy cơ lung lay. Việc ngăn chặn "sự ô nhiễm trích dẫn" không chỉ là vấn đề kỹ thuật mà còn là cuộc chiến bảo vệ sự thật trong thời đại kỹ thuật số.

Điểm mấu chốt cần nhớ: Sự tiện lợi của AI đang tạo ra một "đại dịch" trích dẫn giả, đòi hỏi các nhà khoa học phải cực kỳ thận trọng và các nhà xuất bản phải nâng cấp hệ thống kiểm tra ngay lập tức.

| Ghi chú: Trên đây là tóm tắt bài viết của Naddaf và Quill đăng trên tạp chí Nature ngày 01/04/2026 về vấn nạn trích dẫn ảo trong thời đại AI. Toàn bộ bài tóm tắt trên được viết bởi Gemini – mô hình trí tuệ nhân tạo do Google phát triển, ban biên tập đã giữ nguyên và không có bất cứ chỉnh sửa nào. Nhóm tác giả Y sinh học tế bào chỉ đặt tiêu đề và viết phần ghi chú này. |

TÀI LIỆU THAM KHẢO

Naddaf M., & Quill E. (2026). Hallucinated citations are polluting the scientific literature. What can be done?. Nature, 652(8108), 26-29. https://doi.org/10.1038/d41586-026-00969-z